总编辑圈点丨医学影像安全面临新挑战AI生成的深度伪造X光片能以假乱真

发布时间:2026-03-25 12:07:55| 浏览次数:

美国西奈山伊坎医学院一项最新研究发现,无论是放射科医生还是多模态大语言模型(LLM),都难以轻易区分由人工智能(AI)生成的深度伪造X光影像与真实医学影像。研究人员表示,这一发现凸显了AI生成医学影像可能带来的医疗安全与网络安全风险。相关论文发表于最新一期《放射学》杂志。

“深度伪造”是指看似真实但实际上由AI生成或篡改的视频、照片、图像或音频。AI生成的X光片真实度极高,能以假乱真,可能被用于医疗欺诈,例如伪造骨折影像用于诉讼取证。如果黑客入侵医院系统并植入合成医学影像,还可能篡改诊断结果,甚至破坏电子病历系统的可信度。

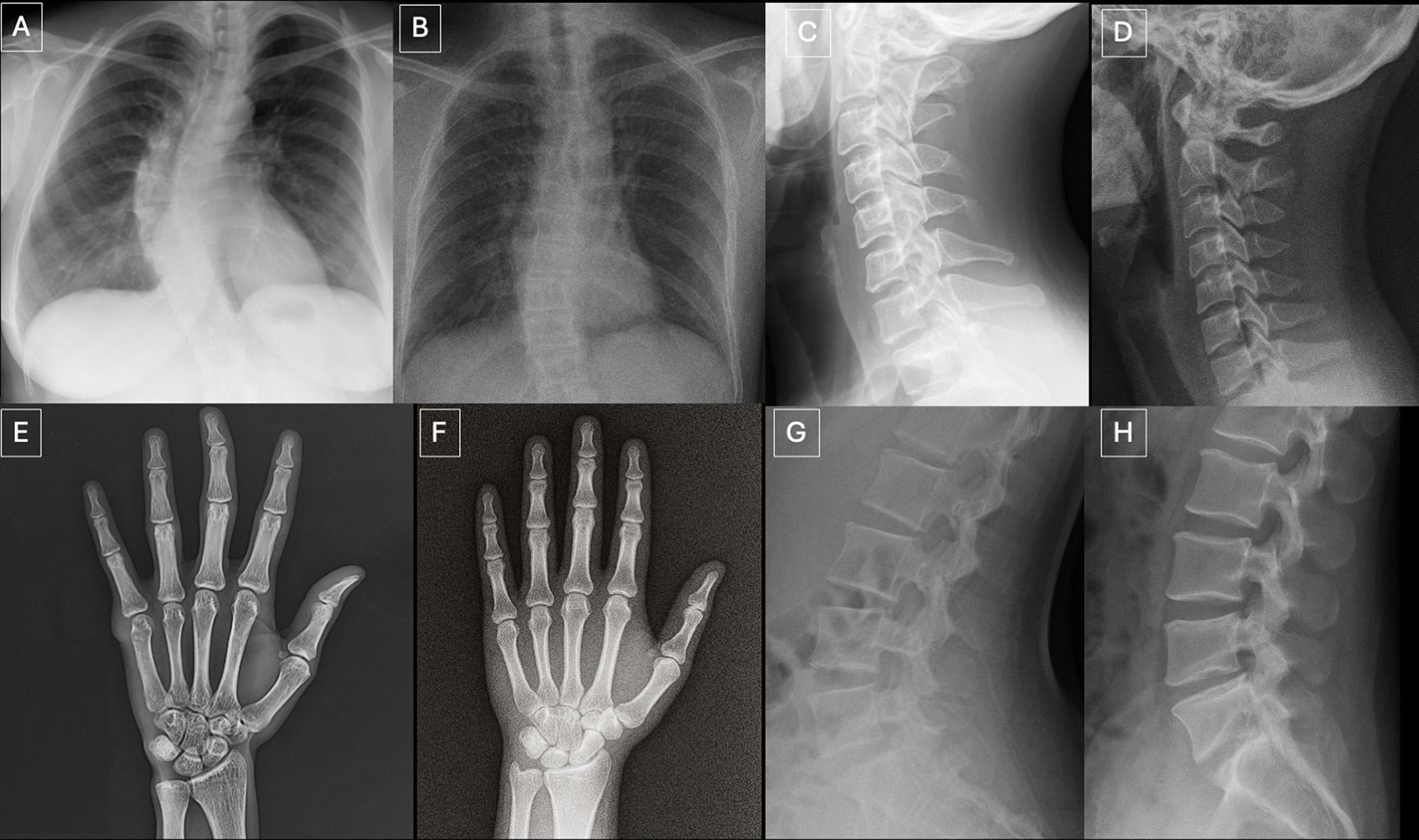

在这项回顾性研究中,来自美国、法国、德国、土耳其、英国和阿联酋6个国家12家医疗中心的17名放射科医生参与测试。研究共分析264张X光影像,分为两组:第一组数据包含多个解剖部位的真实影像以及由ChatGPT生成的影像;第二组数据为胸部X光片,其中一半为真实影像,另一半由斯坦福医学院研究人员开发的开源生成式AI扩散模型RoentGen生成。

结果显示,在未被告知研究目的的情况下,仅有41%的医生主动识别出AI生成图像。在明确告知后,医生区分真实与伪造影像的平均准确率为75%。

与此同时,GPT-4o(OpenAI)、GPT-5(OpenAI)、Gemini 2.5 Pro(谷歌)以及Llama 4 Maverick(Meta)四种多模态大模型也进行了识别测试,其准确率在57%—85%之间。即便是参与生成这些深度伪造影像的GPT-4o模型本身,也无法识别全部伪造影像。

研究人员总结称,AI生成的医学影像往往存在一些“过于完美”的特征,例如骨骼表面过于光滑、脊柱过直、肺部过度对称、血管分布过于均匀,以及骨折断面异常整齐等。

为降低风险,研究团队建议,应在医学影像中嵌入不可见数字水印、增加加密签名等技术手段,以防止影像被篡改,同时加强医学影像AI鉴别能力培训。

总编辑圈点其实,最先出现类似问题的是文字领域。AI从人类语料库中学习如何写作,人类又试图从AI生成内容中揪出“机味”。如今,人类原创的内容和AI撰写的内容混在一起,已难以分辨。如今,同样的难题又进入图像领域。资深医生和大模型自己,都难以准确判断哪些医学影像被AI动了手脚。这项研究给医疗安全敲响了警钟,它甚至可能动摇整个医疗系统的可信度。我们看到,AI的深度渗透,正给所有行业带来前所未有的挑战。